基于RDK X3的人体跟随机器人功能示例

功能介绍

通过视觉进行人体目标检测与跟踪,并生成运动控制指令控制机器人自动跟随目标运动。该功能支持机器人实物和Gazebo仿真两种体验方式。

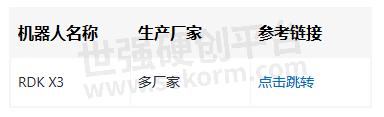

机器人实物物料清单

以下机器人均已适配RDK X3

使用方法准备工作

机器人具备运动底盘、相机及RDK套件,硬件已经连接并测试完毕;

已有ROS底层驱动,机器人可接收“/cmd_vel”指令运动,并根据指令正确运动。

机器人组装

以下操作过程以OriginBot为例,满足条件的其他机器人使用方法类似。参考机器人官网的使用指引,完成机器人的硬件组装、镜像烧写及示例运行,确认机器人的基础功能可以顺利运行。

安装功能包

1.参考OriginBot说明,完成Originbit基础功能安装

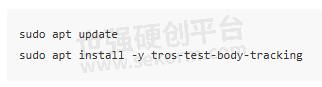

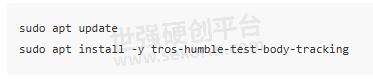

2.安装人体跟随功能包

启动机器人后,通过终端或者VNC连接机器人,点击本页面右上方的“一键部署”按钮,复制如下命令在RDK的系统上运行,完成人体跟随相关Node的安装。

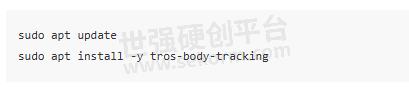

tros foxy版本

tros humble版本

运行人体跟随功能

1.启动机器人底盘

启动机器人,如OriginBot的启动命令如下:

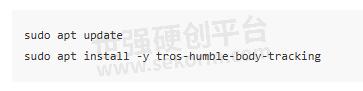

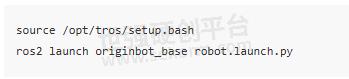

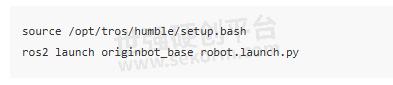

tros foxy版本

tros humble版本

2.启动人体跟随

启动一个新的终端,通过如下指令启动人体跟随功能:

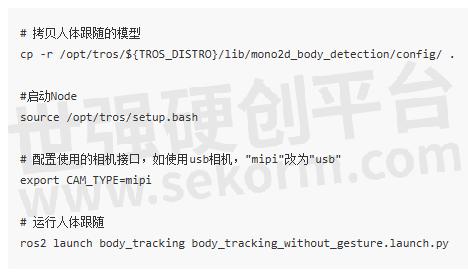

tros foxy版本

tros numble版本

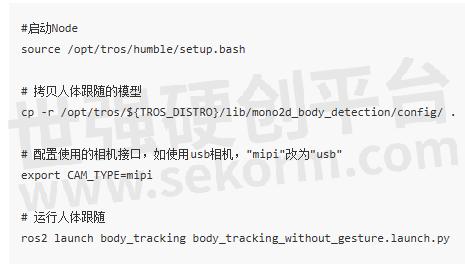

启动成功后,站在机器人摄像头前,需要让机器人识别到整个身体,慢慢移动身体,可以看到机器人已经开始跟随人体运动。若视野中存在多个人体,则以当前占据视野面积最大的人体作为跟踪目标,持续跟随移动。

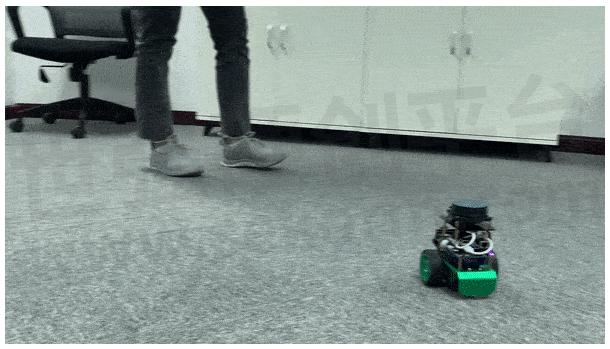

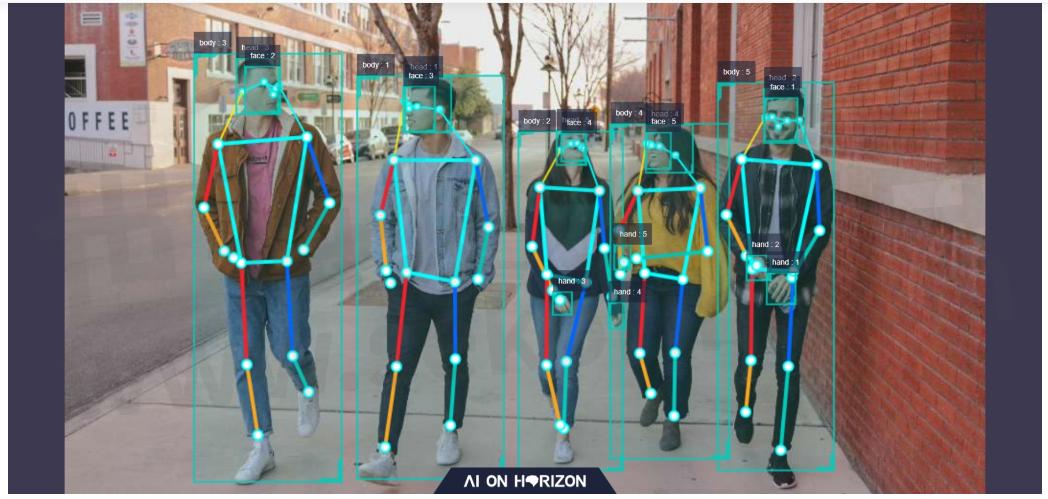

3.查看视觉识别效果

打开同一网络电脑的浏览器,访问机器人的IP地址,即可看到视觉识别的实时效果:

Gazebo仿真

Gazebo仿真适用于持有RDK X3但没有机器人实物的开发者体验人体跟随功能。

物料清单

使用方法准备工作

在体验之前,需要具备以下基本条件:

开发者有RDK套件实物,及配套的相机

PC电脑端已经完成ROS Gazebo及Turtlebot机器人相关功能包安装

确保使用的PC与RDK处于统一网络中

安装功能包

启动RDK X3后,通过终端或者VNC连接机器人,点击NodeHub右上方的“一键部署”按钮,复制如下命令在RDK的系统上运行,完成人体跟随相关Node的安装。

tros foxy版本

tros humble 版本

运行人体跟随功能

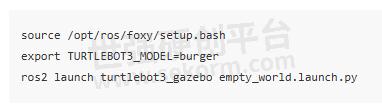

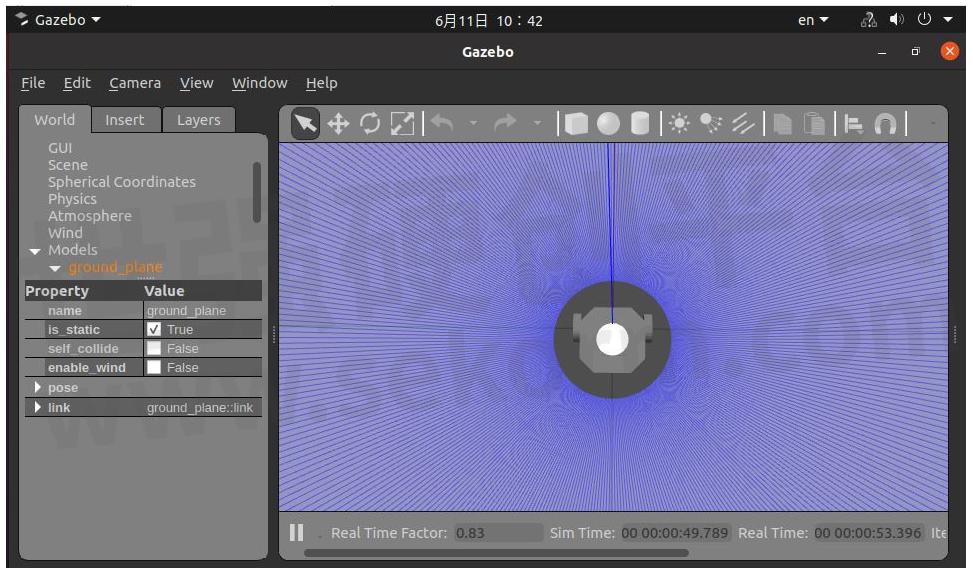

1.启动仿真环境及机器人

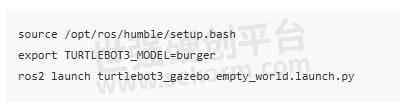

在PC端Ubuntu的终端中使用如下命令启动Gazebo,并加载机器人模型:

foxy版本

humble版本

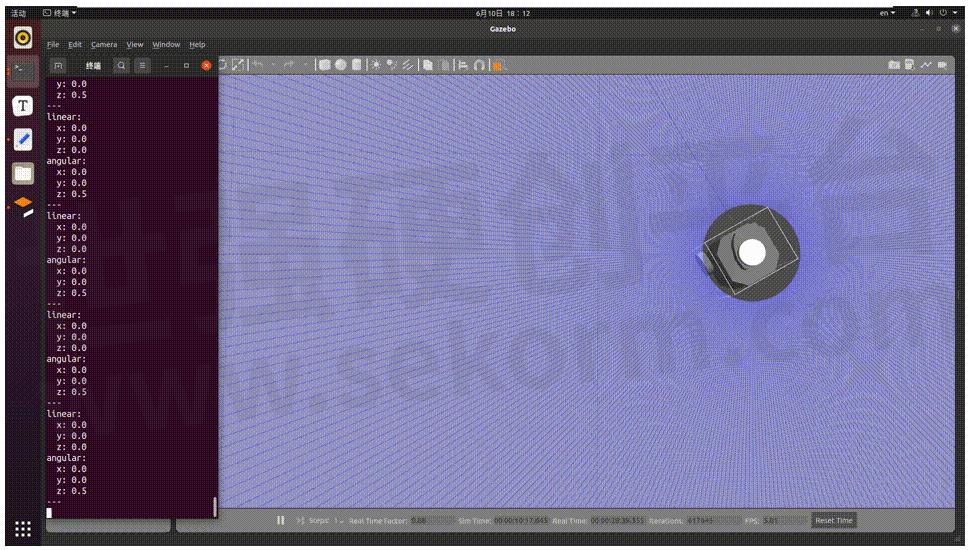

启动成功后,仿真环境中小车效果如下:

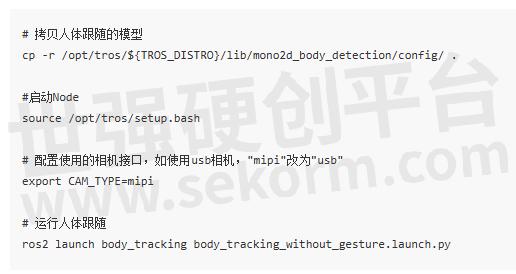

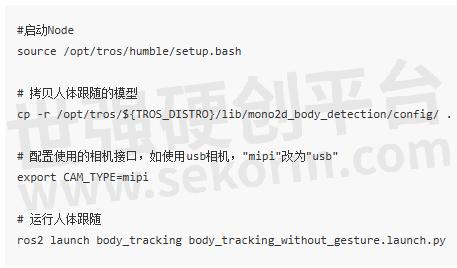

2.启动人体跟随

在RDK的系统中,启动终端,通过如下指令启动人体跟随功能:

tros foxy版本

tros humble版本

启动成功后,站在机器人摄像头前,需要让机器人识别到整个身体,慢慢移动身体,可以看到机器人已经开始跟随人体运动。若视野中存在多个人体,则以当前占据视野面积最大的人体作为跟踪目标,持续跟随移动。

3.查看视觉识别效果

打开PC端的浏览器,访问RDK的IP地址,即可看到视觉识别的实时效果:

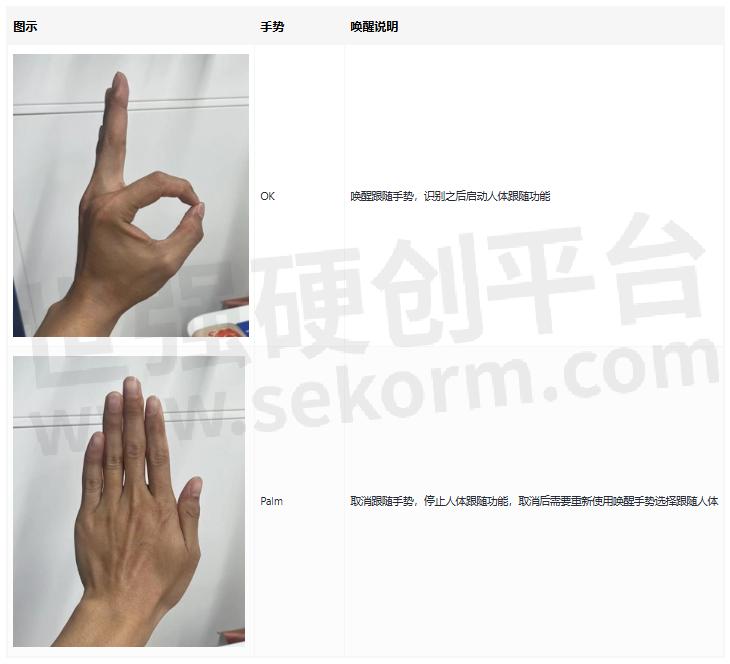

进阶功能手势唤醒

本功能支持通过手势唤醒人体跟随功能,当启用唤醒手势时,机器人会跟随做了唤醒手势的人体。一般用于人较多,环境复杂的场景,通过启用唤醒手势避免误触发控制功能。

如需使用该功能,在运行人体跟随功能时,修改为如下指令,其他操作不变:

tros foxy版本

tros humble版本

手势唤醒说明:

注意:

做唤醒或取消手势时,需要举起手(人手在人肩部以上)做手势,避免手势算法误报导致误唤醒/取消。

接口说明

话题

人体识别和手势唤醒的结果都通过hobot_msgs/ai_msgs/msg/PerceptionTargets话题发布,该话题的详细定义如下:

参数

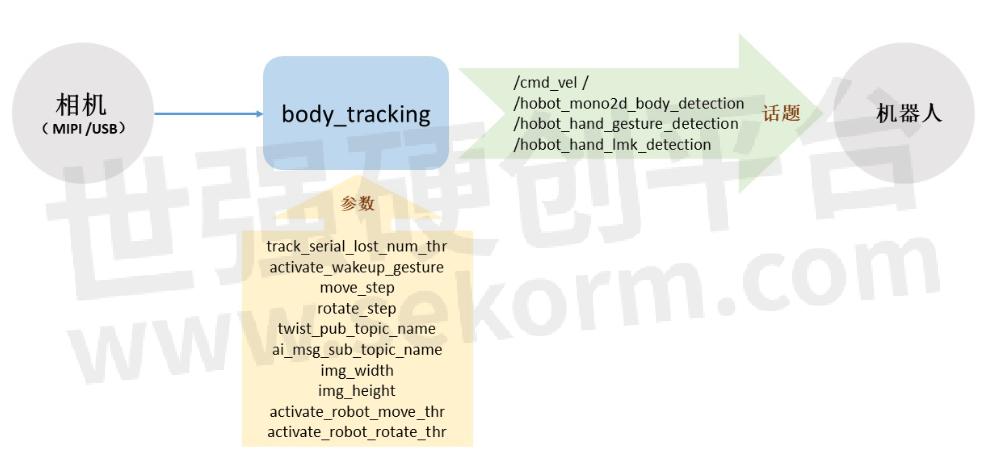

原理简介

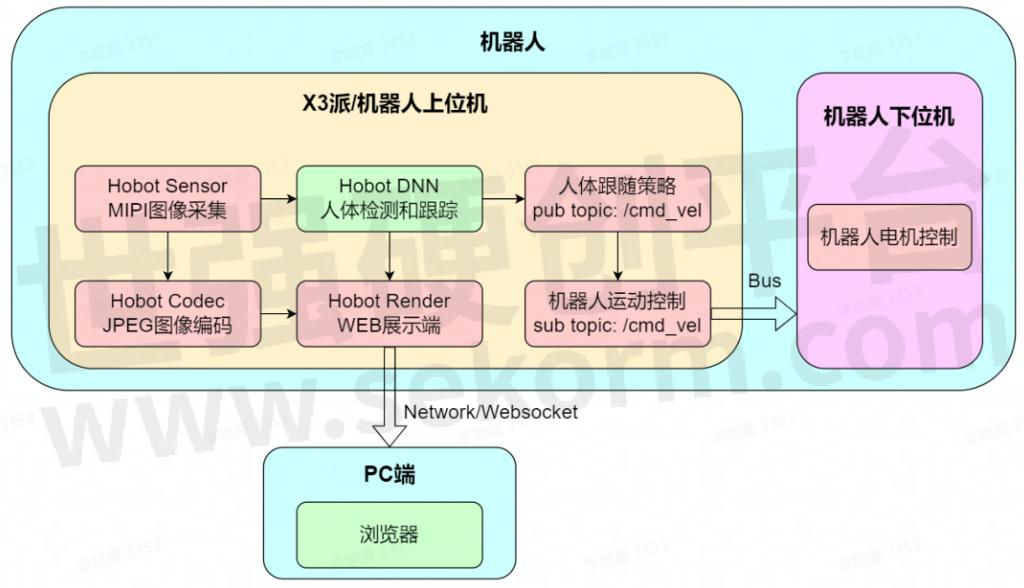

该功能由相机图像采集、人体检测和跟踪、人体跟随策略、图像编解码、WEB展示端等部分组成,流程如下图:

在视野中识别到人体后,判断人体检测框中心点和机器人之间的角度,角度超过阈值(activate_robot_rotate_thr)时,控制机器人旋转,保持被跟随人体在机器人正前方。当被跟随人体消失时,停止机器人运动,并寻找新的被跟随人体。当跟随人体在机器人正前方时,判断人体检测框上边界(检测框的top坐标),超过阈值(activate_robot_move_thr)时,控制机器人运动。

详细实现原理请见“参考资料”。

参考资料

实现原理讲解视频:点击跳转

OriginBot人体跟随示例:点击跳转

常见问题

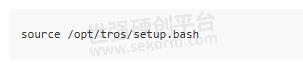

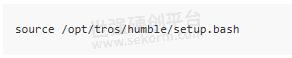

1、Ubuntu下运行启动命令报错-bash: ros2: command not found

当前终端未设置ROS2环境,执行以下命令配置环境:

tros foxy版本

tros humble版本

- |

- +1 赞 0

- 收藏

- 评论 0

本文由雪飘梦飞转载自D-Robotics官网,原文标题为:人体跟随机器人,本站所有转载文章系出于传递更多信息之目的,且明确注明来源,不希望被转载的媒体或个人可与我们联系,我们将立即进行删除处理。

相关推荐

智能语音聊天机器人功能及使用指南

智能语音聊天机器人通过识别用户语音,调用ChatGPT API获取答复并播放,实现语音聊天。需地平线RDK、ChatGPT API Key及音频板等物料。准备、组装后,安装功能包并运行,配置音频和ChatGPT API Key。常见问题包括设备连接、音频驱动、配置文件及网络访问等。

设计经验 发布时间 : 2024-10-18

基于RDK X3的机械臂物体拾取操作实例

本文介绍RDK X3该功能包接收用户选择方块数字的请求,通过yolov5检测目标,在Z轴距离确定的情况下解算出物体的三维坐标,并请求仿真机械臂控制节点夹取物体的应用实例。

设计经验 发布时间 : 2024-10-28

基于RDK X3和OriginBot的手势控制机器人应用案例

通过视觉进行人手检测、跟踪和手势识别,根据手势类别生成不同运动控制指令并控制机器人运动,包括左右旋转和前后平移运动。该功能支持机器人实物和Gazebo仿真两种体验方式。以下操作过程以OriginBot为例,满足条件的其他机器人使用方法类似。

设计经验 发布时间 : 2024-11-13

多模态感知仿生机械手项目案例

本项目提供了一款五指仿生机器手,其仿照人手的外观与自由度,使其能够作为人形机器人的末端执行器,完成人手所能完成的任务。

应用方案 发布时间 : 2024-10-29

双机械臂四转四驱机器人设计与实现

该研究设计了一种创新的双机械臂四转四驱机器人,旨在突破传统轮式机器人的限制。该机器人底盘采用四转四驱设计,显著提升了灵活性和负载能力,使其能够在复杂环境中精确移动和执行任务。双机械臂系统使机器人能够高效与现实生活互动,完成复杂任务。

应用方案 发布时间 : 2024-10-29

基于RDK平台的YOLOv10目标检测算法示例

YOLO功能介绍YOLO目标检测算法示例使用图片作为输入,利用BPU进行算法推理,发布包含目标类别和检测框的算法msg。YOLO目标检测算法示例使用图片作为输入,利用BPU进行算法推理,发布包含目标类别和检测框的算法msg。目前支持yolov2、yolov3、yolov5、yolov5x四个版本。

应用方案 发布时间 : 2024-11-13

NodeHub快速入门

NodeHub是地平线为机器人爱好者打造的智能机器人应用中心,旨在以更加简单、高效、开放的方式协助机器人爱好者开发自己的智能机器人。

技术探讨 发布时间 : 2024-10-30

RDK X3 机械臂捡垃圾经验分享

hobot_arm package 是基于 mono2d_trash_detection package 开发的2D垃圾目标检测+机械臂抓取的应用示例。在地平线的旭日X3派上利用BPU进行模型推理获得感知结果,利用幻尔机械臂作为下位机,进行垃圾抓取的示例。

设计经验 发布时间 : 2024-10-30

地平线RDK实现智能循线机器人应用示例

巡线任务,即机器人小车能够自主跟着一条引导线向前运行。地平线RDK通过摄像头获取小车前方环境数据,图像数据通过训练好的CNN模型进行推理得到引导线的坐标值,然后依据一定的控制策略计算小车的运动方式,通过UART向小车下发运动控制指令实现整个系统的闭环控制。

设计经验 发布时间 : 2024-11-12

基于RDK X3开发板设计并实现的手持slam建图设计

这里使用RDK X3开发板设计并实现了一款SLAM手持建图设备,它使用RDK X3开发板的计算性能,通过激光雷达实现一个纯激光里程计,通过IMU对激光数据进行畸变矫正和对SLAM的姿态矫正,实现一个手持的SLAM建图功能。

设计经验 发布时间 : 2024-11-04

NodeHub快速入门示例:小海龟绘画

NodeHub快速入门示例,通过键盘控制小乌龟进行绘画。

设计经验 发布时间 : 2024-11-11

镭神激光雷达驱动

镭神激光雷达驱动设计方案及应用介绍, LSLIDAR ROS2驱动链接RDK X3,以ROS2标准消息格式发送激光雷达数据。

设计经验 发布时间 : 2024-11-09

连接RDK X3操作奥比中光Astro Pro相机驱动示例

基于RDK X3的奥比中光Astro Pro相机驱动操作方案介绍。

设计经验 发布时间 : 2024-11-08

人形机器人目标检测实例

基于深度学习的方法识别小球和底座,使用模型为YOLOv5s使用方法准备工作具备TonyPi机器人,包含相机及RDK套件,并且能够正常运行。

设计经验 发布时间 : 2024-10-21

基于地平线RDK模型YOLOv5s深度学习的方法进行赛道障碍物检测应用实例

该功能为基于深度学习的方法识别赛道中的障碍物,使用模型为YOLOv5s。地平线RDK通过摄像头获取小车前方环境数据,图像数据通过训练好的YOLO模型进行推理得到障碍物的图像坐标值并发布。

设计经验 发布时间 : 2024-11-08

电子商城

登录 | 立即注册

提交评论